【弁護士監修】AI事業者ガイドラインとは。罰則は?企業が知っておくべきポイントは?わかりやすく解説

2025年03月12日(水)掲載

AI事業者ガイドラインは、AI(人工知能)の安心安全な利用を確保するために、総務省と経済産業省が共同で策定した指針です。革新的な技術としてさまざまな分野でAIが活用されている現在、企業がこのガイドラインを遵守することは、顧客の信頼を獲得し、持続可能なビジネスを実現するために非常に重要だといえるでしょう。

本記事では弁護士監修のもと、AI事業者ガイドラインの概要や対象者、企業側が知っておくべき指針などについて解説します。

■AI事業者ガイドラインとは?

■【対象者別】AI事業者ガイドラインで知っておくべき10の指針

■高度なAIシステムに関係する事業者に共通の指針

■AI導入企業に不可欠な「AIガバナンス」の構築

■まとめ

AI事業者ガイドラインとは?

AI事業者ガイドラインとは、日本におけるAI(Artificial Intelligence。人工知能)の安心安全な利用と社会への貢献を目的として、総務省と経済産業省が共同で策定した指針です。対象には一般企業だけでなく、政府や自治体などの公的機関も含まれます。

まずは、AI事業者ガイドラインが策定された背景や対象者の詳細、違反した場合の罰則について見ていきましょう。(2025年2月時点情報)

総務省と経済産業省が策定した背景と目的

総務省と経済産業省がガイドラインを共同で策定した背景にあるのは、AIの急速な利用拡大です。AI技術は、社会の多岐にわたる分野で開発や活用が進み、生成AIの登場などにより利便性を大幅に向上させてきました。一方で、誤った利用による課題やリスクが多様化していることも事実です。

また、元々は総務省と経済産業省に3つのガイドラインが存在しましたが、それぞれ目的や体系が異なるため、AI事業者からわかりやすいガイドラインの策定が求められていました。

こうした背景から、AI技術を安心安全に利活用できる環境を構築する必要性が高まり、政府は「AI戦略会議」を設置しました。パブリックコメント(意見募集)で寄せられた意見を基に3つのガイドラインの統合や見直しを行いました。「AI事業者ガイドライン」として、2024年4月19日に「第1.0版」を公開。2024年11月22日には、リスク管理への具体的な言及と人間の尊厳と多様性を強調した「1.01版」が公開されました(2025年2月現在)。ガイドラインの遵守による「AIがもたらす社会的リスクの低減」「AIのイノベーションおよび活⽤の促進」を目的としています。

出典:「AI事業者ガイドライン(第1.01版)」(総務省・経済産業省)p.2

なお、AI事業者ガイドラインには「本編」と「別添」があります。本編では、事業者がAIを安心安全に活用し、AIのベネフィットを最大化するための基本理念や重要な取り組みを、別添(付属資料)では実践的な方法や事業者の具体的な行動を示しています。

出典:「AI事業者ガイドライン」掲載ページ(総務省)

AI事業者ガイドライン対象者の範囲

AI事業者ガイドラインで注目すべきは、AIの開発、提供、利用の各段階で、具体的な対応方針が示されていることです。これにより、企業は自社のAI関連事業において、どのような対応が求められているのかを明確に理解することが可能となりました。

対象となる主体者は、以下の3つです。

●AI開発者:AIシステムの設計・開発を行う事業者(研究開発を含む)

●AI提供者:開発されたAIシステムを他者に提供する事業者

●AI利用者:AIシステムを導入・活用する事業者

ただし、3つのいずれかのみに属するということではなく、複数に該当する可能性があることに注意が必要です。例えば「自社でAIを開発し、それを製品として提供しながら社内でも活用する」という企業は、全ての立場に該当することになります。

なお、「事業活動以外でのAI利用者」や「データの提供者」については、このガイドラインの対象外です。

違反した場合の罰則

このガイドラインは「⾮拘束的なソフトロー」という位置付けのため、法的な拘束力はなく、罰則もありません。ただし、遵守しない場合は以下のような実質的なリスクが想定される点に注意が必要です。

●ガイドライン違反が公になった場合の企業イメージの低下(レピュテーションリスク)

●取引先からの信頼喪失や取引停止

●将来的な法規制への対応遅れ など

AI技術の進化は目覚ましく、本ガイドラインも更新されていくと考えられます。今後のAI関連法規制の基礎となる可能性もあるため、早期からのガイドラインへの対応を検討してはいかがでしょうか。

【対象者別】AI事業者ガイドラインで知っておくべき10の指針

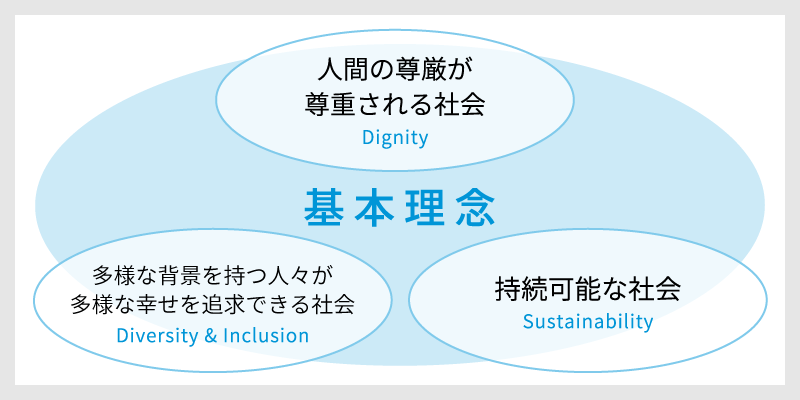

AI事業者ガイドラインの基本理念は、「⼈間の尊厳が尊重される社会」「多様な背景を持つ⼈々が多様な幸せを追求できる社会」「持続可能な社会」の3つです。

参考:「AI 事業者ガイドライン(第1.01版)」(総務省)p.12を基に作成

参考:「AI 事業者ガイドライン(第1.01版)」(総務省)p.12を基に作成

上記を踏まえ、同ガイドラインではAIの開発、提供、利用に関わる全ての主体が遵守すべき基本的な行動指針を提示しています。「共通の指針」に加えて、AI開発者、AI提供者、AI利用者のそれぞれに特化した内容が示されており、各主体が果たすべき責任が明確にされています。

全てのAI事業者が守るべき「共通の指針」と、対象者ごとの指針について、詳しく見ていきましょう。(2025年2月時点情報)

全てのAI事業者が守るべき「共通の指針」

AI事業活動を行うAI開発者、AI提供者、AI利⽤者の全てに共通する基本原則が「共通の指針」です。10の指針と主な観点がガイドラインにまとめられています。

| 主な観点 | |

|---|---|

| 1.⼈間中⼼ |

①⼈間の尊厳および個⼈の⾃律 ②AIによる意思決定・感情の操作等への留意 ③偽情報等への対策 ④多様性・包摂性の確保 ⑤利⽤者⽀援 ⑥持続可能性の確保 |

| 2.安全性 |

①⼈間の⽣命・⾝体・財産、精神および環境への配慮 ②適正利⽤ ③適正学習 |

| 3.公平性 |

①AIモデルの各構成技術に含まれるバイアスへの配慮 ②⼈間の判断の介在 |

| 4.プライバシー保護 | ①AIシステム・サービス全般におけるプライバシーの保護 |

| 5.セキュリティ確保 |

①AIシステム・サービスに影響するセキュリティ対策 ②最新動向への留意 |

| 6.透明性 |

①検証可能性の確保 ②関連するステークホルダーへの情報提供 ③合理的かつ誠実な対応 ④関連するステークホルダーへの説明可能性・解釈可能性の向上 |

| 7.アカウンタビリティ |

①トレーサビリティの向上 ②「共通の指針」の対応状況の説明 ③責任者の明⽰ ④関係者間の責任の分配 ⑤ステークホルダーへの具体的な対応 ⑥⽂書化 |

| 8.教育・リテラシー |

①AIリテラシーの確保 ②教育・リスキリング ③ステークホルダーへのフォローアップ |

| 9.公正競争確保 | ー |

| 10.イノベーション |

①オープンイノベーション等の推進 ②相互接続性・相互運⽤性への留意 ③適切な情報提供 |

具体的には、以下に留意するとよいでしょう。2024年4月に発行された、全主体向けのチェックリストの各項目には、以下のように記載されています。

□ 人間中心の考え方を基に、憲法が保障する又は国際的に認められた人権を侵すことがないようにしているか?

□ AIに関わる全ての者の生命・身体・財産、精神および環境に危害を及ぼすことがないよう安全性を確保しているか?

□ 潜在的なバイアスをなくすよう留意し、それでも回避できないバイアスがあることを認識しつつ、回避できないバイアスが人権および多様な文化を尊重する公平性の観点から許容可能か評価しているか?

□ プライバシーを尊重し、保護し、関係法令を遵守しているか?

□ 不正操作によってAIの振る舞いに意図せぬ変更または停止が生じることのないように、セキュリティを確保しているか?

□ 透明性を確保するために、AI自体やAIシステム、サービスの情報をステークホルダーに対し合理的で技術的に可能な範囲で提供しているか?

□ データの出所、AIの意思決定等のトレーサビリティに関する情報やリスクへの対応状況等について、関連するステークホルダーに対して合理的な範囲でアカウンタビリティを果たしているか?

□ AIガバナンスやプライバシーに関するポリシー等を策定しているか?

AI開発者に関する事項

AI開発者(AI Developer)は、AIモデルの設計や変更を通じてシステム全体に対する責任を持ちます。出力結果が社会全体に与える影響は大きいため、AIの提供や利用に備えて、事前の検討や対応策の実施が必要です。

加えて、開発において正確性やプライバシー、透明性が衝突する場面では、経営リスクや社会的影響を考慮し、適切に判断し修正することが求められます。また、予期せぬ事故に備え、関与内容を記録し、合理的な説明ができる体制を整えることも重要です。

AI開発者が留意すべき事項を、段階ごとにご紹介します。

1:データ前処理・学習時

AIシステムの精度を左右する重要な工程が、データの前処理と学習プロセスです。この段階では以下の点に注意を要します。

プライバシー・バイ・デザイン(PbD:Privacy by Design)などを通じて学習時に使用するデータに関して、適切に収集する。第三者の個人情報、知的財産権に留意が必要なものが含まれている場合には、法令に従って適切に扱う

学習前および学習全体を通じて、データのアクセス管理を行うためのデータ管理や制限機能の導入を検討し、適切な保護対策を講じる

学習データ、AIモデルの学習プロセスにおいてバイアスが含まれる可能性があることに注意し、データの質を管理するための相応の措置を講じる。AIモデルが代表的なデータ群により学習され、AIシステムに不公正なバイアスが含まれていないかを検証することを徹底する

2:AI開発時

開発段階では、以下の点が重要です。

さまざまな状況下で予想される利用条件下でのパフォーマンスだけでなく、予期しない環境下でも対応可能な性能や、リスクを最小限に抑える方法の要求などを検討する。ステークホルダーの生命・身体・財産、精神および環境に危害を及ぼすことがないよう留意する

開発時に想定外のAIの提供や利用によって危害が生じることを防ぐべく、安全なAIの利用方法に関する明確な方針やガイダンスを策定する。事前学習済みのAIモデルに対する事後学習を実行する場合に、学習済みAIモデルを適切に選択する

AIモデルを構成する各技術要素によってバイアスが含まれる可能性について検討する。AIモデルからバイアスを完全に排除するのは困難である点を踏まえ、AIモデルが代表的なデータセットで学習されるとともに、AIシステムに不公正なバイアスが含まれていないかを検証する仕組みを確立する

AIシステムの開発の過程を通じて、採用する技術の特性に照らし合わせ、適切にセキュリティ対策を講じる

AIの予測性能や出力品質が、活用開始後に大きく変動したり、想定した精度に達したりしない可能性がある特性を踏まえ、事後の検証に備えて作業記録を保存する。また、その品質の維持・向上に努める

3:AI開発後

AI開発者には、開発終了後も、AIの安全性と信頼性を維持するための責任が求められます。

AIシステムに対する攻撃手法は、日々新たなものが生まれていると認識する。新たなリスクに対応するため、開発の各プロセスで注意すべきポイントを確認する

自らの開発するAIシステムについて、AIシステムの学習などによる出力やプログラムの変化の可能性、安全性確保の仕組み、利用の結果生じる可能性のある予期可能なリスクに備える。その緩和策などの安全性に関する情報、開発時に想定していないAIの提供・利用による危害の発生を防ぐため、AI開発者が意図する利用範囲などの情報を、適時かつ適切に関連するステークホルダーに提供する

AI提供者に対して、AIには活用開始後に予測性能や出力の品質が大きく変動する可能性、想定する精度に到達しないこともある旨と、その結果生じるリスクなどの情報提供および説明を実行する。具体的には、AIモデルを構成する各技術要素において含まれる可能性があるバイアスへの対応などを周知する

トレーサビリティおよび透明性の向上のため、AIシステムの開発過程、意思決定に影響を与えるデータを収集する。またラベリングや使用されたアルゴリズムなどについて、可能な限り第三者が検証できるような形で文書化する

AI提供者に関する事項

AI提供者(AI Provider)は、開発されたAIシステムに付加価値を加えて、AI利⽤者にシステムやサービスを提供します。そのため、AIの適正な利用を前提としたAIシステム・サービスの提供を実現することが重要です。留意事項は以下の通りです。

・人間の生命・身体・財産、精神および環境に配慮したリスク対策

・適正利用に資する提供

・AIシステム・サービスの構成およびデータに含まれるバイアスへの配慮

・プライバシー保護のための仕組みおよび対策の導⼊

・セキュリティ対策のための仕組みの導⼊

・システムアーキテクチャ等の⽂書化

・適正利⽤に資する提供

・プライバシー侵害への対策

・脆弱性への対応

・関連するステークホルダーへの情報提供

・AI利⽤者への「共通の指針」の対応状況の説明

・サービス規約等の⽂書化

具体的には、AIシステムやサービスに組み込むAIがふさわしいものかに留意し、適切な変更管理、構成管理、およびサービスの維持を実行します。また、AIシステムやサービスをAI開発者が意図している範囲で実装し、正常稼働および適正な運用を継続します。さらに、AI開発者に対してシステムが適正に開発されるよう求めることも提供者の役割です。

AI利用者への提供に際し、ステークホルダーの権利を損なわず、かつ社会に不利益などを生じさせないように注意しながら、合理的な範囲でインシデント事例を含む関連情報の共有を実行しましょう。

AI利用者に関する事項

AI利用者(AI Business User)とは、AIシステムやサービスを活用して事業活動や業務を行う企業や団体などを指します。ガイドラインにおいてAI利用者に求められるのは、安全性や公平性、プライバシー保護、セキュリティ確保、透明性、アカウンタビリティといった各観点からの適正な利用です。

・安全を考慮した適正利用

・入力データまたはプロンプトに含まれるバイアスへの配慮

・個人情報の不適切入力およびプライバシー侵害への対策

・セキュリティ対策の実施

・関連するステークホルダーへの情報提供

・関連するステークホルダーへの説明

・提供された文書の活用と規約の遵守

AIシステムの利用時には、提供者が定めたルールを守り、入力データの最新性とバイアス、個人情報などプライバシーにも配慮する必要があります。また、AI出力結果を事業判断に用いる際には、ステークホルダーに合理的な範囲で情報を提供し、説明責任を果たすことも重要です。特に高度なAIシステムを取り扱う利用者には、責任のある利用を促進してリスクを最小化し、社会的信頼を維持することが求められます。

高度なAIシステムに関係する事業者に共通の指針

高度なAIシステムに関係する事業者には、上記の事項に加え、以下の事項を「遵守すべきである」と強く求めています。ここでいう「高度なAIシステム」とは、最先端の基盤モデルや生成AIを含む、高度なAIシステムのことです。主にAI開発者向けですが、定義上は高度なAIを取り扱う全ての事業者が対象のため、提供者と利用者も可能な範囲での対応が必要です。

1.AIライフサイクル全体にわたるリスクを特定、評価、軽減するために、高度なAIシステムの開発全体を通じて、その導入前および市場投入前も含め、適切な措置を講じる

2.市場投入を含む導入後、脆弱性、および必要に応じて悪用されたインシデントやパターンを特定し、緩和する

3.高度なAIシステムの能力、限界、適切・不適切な使用領域を公表し、十分な透明性の確保を支援することで、アカウンタビリティの向上に貢献する

4.産業界、政府、市民社会、学界を含む、高度なAIシステムを開発する組織間での責任ある情報共有とインシデントの報告に向けて取り組む

5.特に高度なAIシステム開発者に向けた、個人情報保護方針および緩和策を含む、リスクベースのアプローチに基づくAIガバナンスおよびリスク管理方針を策定し、実施し、開示する

6.AIのライフサイクル全体にわたり、物理的セキュリティ、サイバーセキュリティ、内部脅威に対する安全対策を含む、強固なセキュリティ管理に投資し、実施する

7.技術的に可能な場合は、電子透かしやその他の技術等、AI利用者および業務外利用者等が、AIが生成したコンテンツを識別できるようにするための、信頼できるコンテンツ認証および来歴のメカニズムを開発し、導入する

8.社会的、安全、セキュリティ上のリスクを軽減するための研究を優先し、効果的な軽減策への投資を優先する

9.世界の最大の課題、特に気候危機、世界保健、教育等(ただしこれらに限定されない)に対処するため、高度なAIシステムの開発を優先する

10.国際的な技術規格の開発を推進し、適切な場合にはその採用を推進する

11.適切なデータインプット対策を実施し、個人データおよび知的財産を保護する

12.高度なAIシステムの信頼でき責任ある利用を促進し、貢献する

12項目の詳細は、実際のガイドラインでご確認ください。

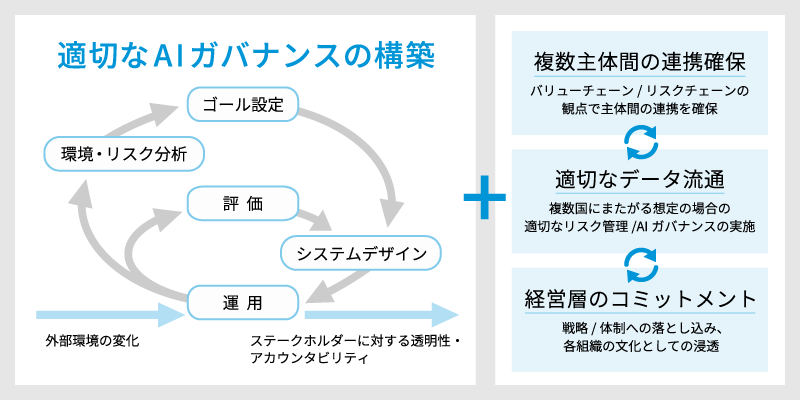

AI導入企業に不可欠な「AIガバナンス」の構築

AIガバナンスとは、AIの開発や運用を安全かつ倫理的に管理する枠組みのことです。AI事業者は、AIに伴うリスクを管理する役割を担うことから、AIの安全性や公平性、プライバシー保護などを確保しながら適正に利用するために、基盤となるガバナンスの構築が不可欠です。

AIの利用拡大に伴い、公平性の欠如やデータの偏りによる差別、セキュリティリスク、他者の権利侵害など、従来のAIとは違う問題が顕在化しており、これらに対応するためガバナンスの重要性は増しています。

例えば、AIが誤った判断を行い、不適切な結果を生むケースでは、企業の信頼性が大きく損なわれる可能性があります。これに対処するため、企業はAIモデルの透明性や説明責任を確保し、バイアスの排除やリスクの事前評価を徹底する必要があるでしょう。また、生成AIの普及により、機密情報や個人情報の不適切な利用といった新たなリスクも出現しており、これらを柔軟に管理する体制が求められます。

さらに、AI活用を通じたビジネス価値を最大化するためには、倫理基準や法規制を遵守しつつ、変化するリスクに対応する柔軟な仕組みを構築することが必要です。下の図のように変化を踏まえて改善するサイクルを回すようにしましょう。

参考:「AI事業者ガイドライン(第1.0版)概要」(総務省・経済産業省)p.16を基に作成

参考:「AI事業者ガイドライン(第1.0版)概要」(総務省・経済産業省)p.16を基に作成AIガバナンスの確立は、企業の信頼性向上と競争力強化のカギを握る重要な取り組みといえます。

まとめ

AI事業者ガイドラインは、急速に進化するAI技術の健全な発展と安全な利活用を目指す重要な指針です。AI開発から利用までの各段階における具体的な対応方法を示しており、ガイドラインの遵守は、責任を持ってAI技術を利活用するために重要であると同時に、事業者が提供するサービスの品質向上や外部へのアピールにつながる可能性もあります。

AIの進化のスピードは速く、今後もガイドラインの改定が予想されます。常に最新の動向に注目し、必要な対策を講じながら柔軟に対応していきましょう。

「HiPro Biz」ではAIに関する知見を保有するプロ人材が多数登録しています。ぜひ「HiPro Biz」のサービスをご検討ください。

監修

弁護士法人ブライト 和氣良浩 弁護士▼生成AIに関する調査資料はこちら

生成AI活用実態の調査レポート 〜大手企業役職者522名の視点から読み解く、導入効果・課題・投資戦略〜

▼関連記事

・【大手企業の部長以上522名調査】生成AIの導入率は約8割。成果の分かれ道は「ルール整備」と「人材育成」

・AIガバナンスの活路は稀少人材にあり?プロ人材が詳解する、形骸化しないAIリスク対応策

▼HiPro Biz導入事例資料

導入事例のご紹介~DX編~

![顧問、専門家のプロ人材紹介サービス | HiPro Biz [ハイプロ ビズ]](/img/logo.svg)